EKF를 공부하기 전 필요한 배경지식들을 정리하고 넘어가고자 합니다.

1. covariance matrix (공분산 행렬)

먼저 공분산의 정의를 짚고 넘어가고자 합니다.

공분산(共分散, 영어: covariance)은 2개의 확률변수의 선형 관계를 나타내는 값이다

수학적인 정의는 아래와 같습니다.

스칼라 값을 가지는 두 확률변수 X,Y에 대해 상관관계를 파악하기 위해 공분산을 사용하고,

공분산이 양수인 경우 확률변수 X가 커지면 Y도 커지는 양의 상관관계를

공분산이 음수인 경우 확률변수 X가 커짐에도 Y는 작아지는 음의 상관관계를

공분산이 0이면 확률변수 X의 변화와 Y의 변화는 양도, 음도 아닌 관계를 가짐을 의미합니다.

(공분산은 선형 관계를 말하는 것임으로 공분산이 0임이 관계가 없음을 의미하는 것이 아님 !, 대표적인 반례로 원의 방정식을 예로 들 수 있다)

추가로 기댓값의 성질을 사용하면 수식을 아래와 같이 변형할 수 있습니다.

여기서 잠깐 !

보통 분산이라고 하면 , 확률분포가 얼마나 퍼져있나 ? 를 상상하게 되는데요

공분산은 두 변수간의 상관관계다 라는 정의가 분산을 먼저 배우고 , 공분산을 배운 사람은 이해가 잘 되지 않을 수 있습니다.

여기서 분산은 공분산의 special한 case라는 점을 확인할 수 있습니다.

공분산 -> 함께 얼마나 변하는가 ?

분산 -> 혼자 얼마나 변하는가 ? - 한 확률변수가 평균을 중심으로 얼마나 퍼져있는가 ?

라고 생각하면서 이해를 할 수 있었습니다.

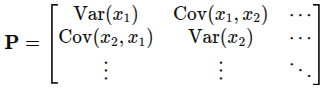

다시 돌아와서 ... covariance matrix (공분산 행렬) 이란

우리는 행렬과 벡터를 학습함으로써 단순 스칼라에서 행렬을 통해 더 고차원의 것을 표현하는 방법을 배우는데요, 이 또한 해당 맥락으로 이해할 수 있습니다.

단순히 스칼라로 표현되던 확률 변수를 , 1차원이 아닌 n차원으로 표현되는 vector로 표현할 수 있고이는 기존 공분산 또한 행렬로 계산될 수 있음을 말해줍니다. (스칼라 확률변수를 벡터 확률변수로 확장)

여기서 보다시피 벡터 확률변수 안에는 여러 확률 변수가 들어있고 , 이 안의 각각의 변수에 대한 상관관계가 궁금할 수 있습니다. 이를 표현한 것이 공분산 행렬입니다.

확률 이론 및 통계학에서 공분산 행렬 ( 자기공분산 행렬 , 분산 행렬, 분산 -공분산 행렬이라고도 함 ) 은 주어진 확률 벡터 의 각 요소 쌍 사이의 공분산을 나타내는 정사각 행렬입니다 .

정의에 따라 정리하면, 대각성분은 각 확률변수의 자기자신에 대한 공분산 ( 분산 ) 이고, 그 외 성분은 다른 성분들과의 공분산입니다.

이에 대한 성질로

- 대칭행렬 ( 당연하죵 )

- 양의 준정부호행렬 ( 설명하려면 조금 길거같아 나중으로 미룬다 , 양의 준정부호행렬은 행렬의 고유값이 모두 >=0 인 행렬을 말하고, 대칭행렬임을 이용하면 유도할 수 있다! )

2. Jacobian

로봇공학 전공에게 익숙한 jacobian이다.

jacobian의 정의는 특정 변수 x가 변할 때, y값은 얼마나 변함 ? 을 편미분으로 표현한 행렬이고 아래와 같다.

https://en.wikipedia.org/wiki/Jacobian_matrix_and_determinant

함수 f가 n->m을 매핑하는 함수로써 변수로 n개의 state를 가지고 , m개의 결과값을 가진다고 생각하면 된다.

n개의 state 각각이 m개의 결과 각각에 어떤 영향을 미치는지를 표현한 행렬이다.

(로봇으로 예를 들면 , 6개 joint 각각의 theta가 Cartesian space에서 end effector의 position ( x, y, z, roll , pitch, raw ) 6개 변수를 어떻게 변화시키는지를 생각해보면 직관적으로 이해가 된다. )

3. Gaussian

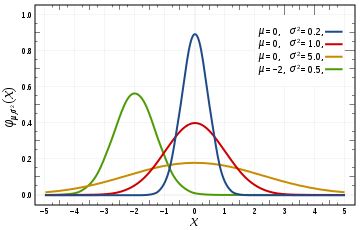

고등학교 때 많이들 배우는 종모양의 그놈이다. 다른 말로는 정규분포이다.

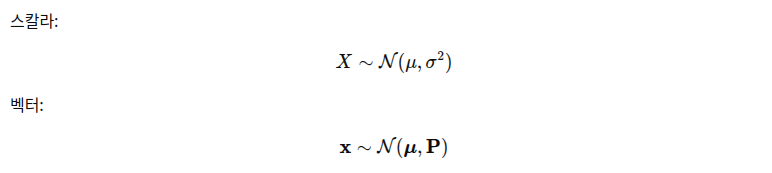

KF에서 다루는 확률은 가우시안의 평균과 공분산을 활용하여 다룬다 . 차이가 있다면

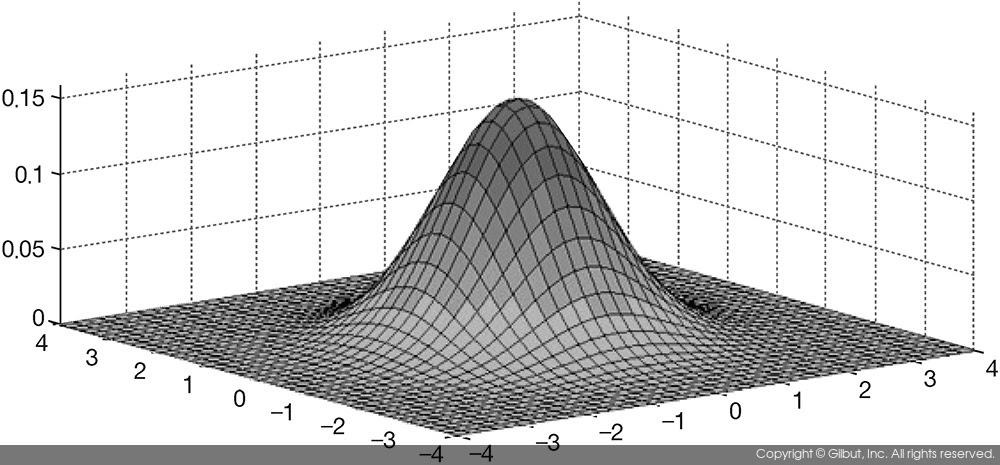

우리가 고등학교 시절에 배운 아래와 같은 그래프를 가지는 표준정규분포, 가우시안은 앞서 언급한 것처럼 1D 즉 , 스칼라 확률변수를 가지는 가우시안이고 앞으로 다룰 가우시안은 벡터 확률변수의 가우시안이다.

상태를 결정론적인 관점에서 어떠한 값이 존재한다고 보는 것이 아닌 확률을 가진 확률변수로써 바라보고 ,

이러한 확률변수가 확률을 가지는 분포를 표현한 확률밀도함수(PDF)를

가우시안 분포 - 정규분포로 가정하여

해당 분포의 대표값인 평균( mean ) , 공분산 (covariance) 으로 해석한다.

* 가우시안의 확률밀도함수는 평균(mean)을 중심으로 퍼져있으며, covariance로 퍼진 크기와 방향을 표현한다.

고 생각하면 될 듯하다.

이렇게 g선생이 말하주는 EKF를 공부하기 위한 사전지식들을 정리해보았습니다. 알고 있었지만 가물가물한 내용도 있었는데 다시 보니 기분이 좋네요. 그럼 다음 포스팅에 본격적인 EKF 리뷰를 해보도록 하겠습니다.

오류 , 수정사항 지적 환영합니다 ~

'robotics' 카테고리의 다른 글

| PnP : Perspective-n-Point (1) | 2026.02.27 |

|---|---|

| EKF (0) | 2026.01.28 |

| EKF - Kalman filter (0) | 2026.01.27 |